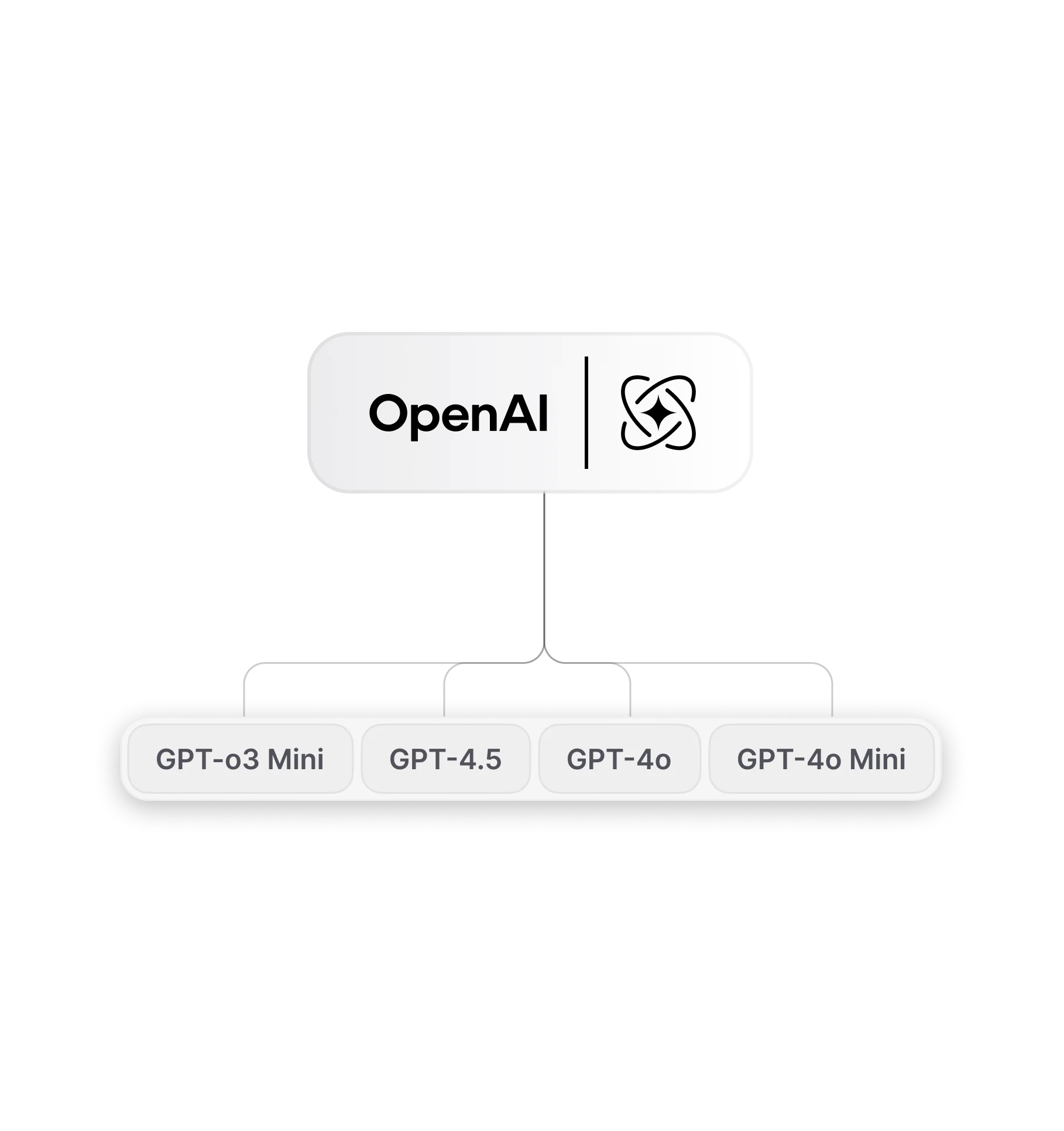

Chat y Preguntas con IA: Desarrollado sobre modelos de OpenAI

Chat y Preguntas con IA ofrece acceso a una gama de modelos de OpenAI que desempeñan funciones técnicas distintas en análisis, asistencia de código, procesamiento de imágenes y tareas de respuesta rápida. La plataforma integra versiones diseñadas para razonamiento de alta precisión, entradas multimodales y rapidez de respuesta para apoyar una amplia variedad de flujos de trabajo. Las secciones siguientes explican cómo se organizan los modelos, cómo aceptan texto y archivos, y cómo la familia de modelos contribuye a tareas como análisis estructurado, creación de contenido y resolución de problemas de forma neutral y objetiva.

Modelos avanzados de IA: Basados en GPT-5.2 y GPT-5.1

La familia OpenAI dentro de Chat y Preguntas con IA representa sistemas a gran escala desarrollados sobre infraestructura avanzada de entrenamiento y motores de inferencia. La plataforma incluye instancias descritas como impulsadas por GPT-5.1, impulsadas por GPT-5, desarrolladas sobre OpenAI o3, construidas sobre GPT-4o, impulsadas por GPT-4o-mini y construidas sobre GPT-4.1. Cada instancia refleja distintos compromisos técnicos: unas se enfocan en razonamiento detallado y en múltiples pasos; otras manejan procesamiento multimodal o priorizan respuestas de baja latencia. Los modelos se asignan a tareas que coinciden con la precisión requerida, el formato de entrada y el tiempo de respuesta.

Roles del modelo y posicionamiento técnico

Los modelos impulsados por GPT-5.2 y impulsados por GPT-5 están orientados a tareas que requieren razonamiento avanzado y generación de contenido complejo.

El modelo desarrollado sobre OpenAI o3 apunta a una capacidad amplia frente a diversos tipos de entrada.

Los modelos construidos sobre GPT-4o y construidos sobre GPT-4.1 soportan flujos de trabajo multimodales y manejo de contextos extensos.

El modelo impulsado por GPT-4o-mini está diseñado para interacciones de respuesta rápida, en las que la baja latencia es importante.

Los modelos se integran en flujos de trabajo según el tipo de tarea, equilibrando coste de inferencia, latencia y profundidad de contexto.

Capacidades y manejo de entradas

Los modelos aceptan texto plano, indicaciones estructuradas, documentos subidos, fragmentos de código e imágenes. Las entradas con contexto largo son gestionadas por modelos con ventanas de contexto extendidas; las entradas multimodales (texto más imágenes) se dirigen a modelos configurados para interpretación visual. La plataforma ofrece controles tipo API para el formato de indicaciones, instrucciones del sistema y límites de tokens para gestionar la longitud y el enfoque de la salida.

Capacidades clave en la familia de modelos

En la familia OpenAI, las capacidades compartidas incluyen razonamiento estructurado, asistencia en programación, salida multilingüe y comprensión multimodal. Estos comportamientos son producto de arquitecturas entrenadas con conjuntos de datos variados y ajustadas para tareas prácticas, lo que permite a la plataforma asignar el modelo apropiado para análisis, resumen o trabajo generativo.

Razonamiento, programación y manejo de tareas complejas

Los modelos abordan el razonamiento en varios pasos descomponiendo las tareas en etapas intermedias y devolviendo salidas estructuradas cuando procede. Para tareas de programación, los modelos pueden generar fragmentos de código, explicar código y ayudar con depuración o refactorización si se proporciona entrada y contexto claros. Las tareas analíticas se basan en explicaciones por pasos, resumen de datos y extracción de puntos clave de documentos suministrados.

Capacidades multimodales y de contexto extendido

Ciertos modelos procesan imágenes junto con texto para extraer detalles visuales, anotar contenido o combinar datos visuales y textuales en respuestas coherentes. Los modelos con ventanas de contexto mayores retienen un historial de conversación más amplio y manejan documentos extensos, dando soporte a flujos de trabajo que requieren continuidad contextual a lo largo de múltiples interacciones.

Uso de modelos de OpenAI dentro de Chat y Preguntas con IA

Dentro de Chat y Preguntas con IA, la selección de modelos y el envío de tareas siguen una interfaz descriptiva: se puede seleccionar una versión del modelo, elegir los formatos de entrada y lanzar tareas con parámetros configurables. El sistema enruta las solicitudes a la instancia de modelo elegida y devuelve salidas formateadas para revisión, edición o exportación.

Flujo de interacción y tipos de entrada admitidos

Indicaciones de texto y consultas en lenguaje natural

Documentos subidos (PDF, DOCX, PPTX) para resumir o realizar preguntas y respuestas

Fragmentos de código para generación y depuración

Archivos de imagen para subtitulado, análisis o indicaciones multimodales

Cada entrada se analiza, tokeniza y envía al modelo seleccionado con las instrucciones proporcionadas y las directivas opcionales a nivel de sistema.

Disponibilidad, estabilidad y notas de acceso

La disponibilidad de modelos depende de la provisión de la plataforma y la asignación de instancias. Los indicadores de estado informan sobre límites de tasa, solicitudes en cola o ventanas de mantenimiento que pueden afectar los tiempos de respuesta. Las notificaciones de la plataforma y las páginas de estado proporcionan información actual sobre acceso y estabilidad.

Avances hacia la generación GPT-6

Los ciclos recientes de desarrollo en sistemas construidos sobre GPT-5.4 y potenciados por GPT-5.3 Codex reflejan una transición continua hacia modelos de interacción con memoria consciente y persistencia de flujos de trabajo extendidos. Los avances anteriores introducidos a través de arquitecturas basadas en GPT-4o y potenciadas por GPT-4o mini establecieron un procesamiento multimodal más sólido y una mejor gestión de contextos largos, formando la base técnica para las próximas generaciones. Dentro de esta progresión, los sistemas futuros alineados con arquitecturas esperadas más allá de GPT-5 están ampliamente asociados con una continuidad de contexto ampliada, una profundidad de razonamiento adaptativa y una ejecución unificada en flujos de trabajo de programación, navegación y análisis estructurado. Los esfuerzos de escalado de infraestructura y la expansión de los pipelines de entrenamiento observados en entornos desarrollados sobre frameworks de computación de nueva generación indican que los sistemas asociados con la próxima generación GPT-6 pondrán un mayor énfasis en la memoria persistente de interacción, la continuidad extendida de sesiones y la ejecución coordinada de múltiples pasos entre tareas. Estos desarrollos sugieren que las arquitecturas alineadas con GPT-6 pueden representar un cambio hacia modelos operativos orientados a flujos de trabajo, capaces de mantener un contexto estructurado durante ciclos de interacción más largos, y de soportar una gestión de tareas más adaptativa y sostenida en diversos flujos de trabajo técnicos y creativos.

Preguntas Frecuentes

¿Qué modelos de OpenAI están disponibles dentro de Chat y Preguntas con IA?

Las instancias disponibles incluyen impulsadas por GPT-5.1, impulsadas por GPT-5, desarrolladas sobre OpenAI o3, construidas sobre GPT-4o, impulsadas por GPT-4o-mini y construidas sobre GPT-4.1 para distintos tipos de tareas.

¿Cómo manejan estos modelos texto, imágenes u otras entradas multimodales?

Los modelos preparados para uso multimodal aceptan imágenes junto con texto; las instancias solo de texto procesan indicaciones y documentos. El enrutamiento depende de las capacidades del modelo seleccionado.

¿Los modelos de OpenAI en Chat y Preguntas con IA tienen límites de uso o restricciones de contexto?

Sí. Los límites de tokens y de tasa dependen de la configuración de la instancia; la capacidad de contexto extendido varía según la selección del modelo.

¿Cómo pueden los usuarios acceder o cambiar entre distintos modelos de OpenAI?

La selección de modelo se realiza en la interfaz de la plataforma al iniciar una sesión o tarea; el cambio está permitido por solicitud según el acceso de cuenta y la provisión.

¿Los modelos de OpenAI son adecuados para tareas como programación, análisis y generación de contenido?

Sí. Instancias específicas están designadas para generación de código, flujos analíticos y creación de texto según la precisión y la longitud de contexto requeridas.

¿Existe una forma gratuita de usar modelos de OpenAI dentro de Chat y Preguntas con IA?

Los niveles de la plataforma pueden incluir membresía gratuita con acceso a modelos básicos; la disponibilidad de instancias concretas depende de las políticas de acceso de la plataforma.

¿Cómo funciona la tarificación de los modelos de OpenAI cuando se usan a través de la plataforma?

La tarificación varía según la instancia del modelo, el volumen de uso y el nivel de suscripción. Los recursos de facturación de la plataforma ofrecen información detallada sobre precios.

¿Qué deben hacer los usuarios si un modelo de OpenAI aparece no disponible o sin respuesta?

Comprobar los indicadores de estado de la plataforma, reintentar la solicitud y consultar al soporte o la documentación de estado si los problemas persisten.

¿Cómo manejan los modelos la seguridad, la precisión y la generación confiable de salidas?

Los controles a nivel de sistema, las guías de indicaciones y los filtros de contenido reducen salidas inseguras; la precisión depende de la claridad de la indicación y el contexto proporcionado.

¿Se pueden usar los modelos de OpenAI para creación de imágenes u otras tareas creativas?

Sí. Los modelos configurados con canales de generación de imágenes admiten síntesis de imágenes y renderizado de estilos cuando esas funciones están habilitadas en la plataforma.answer

¿Cómo se gestiona el acceso a actualizaciones o nuevos lanzamientos de modelos en la plataforma?

Las actualizaciones de modelos se implementan según la política de la plataforma; la disponibilidad de nuevos lanzamientos sigue la provisión y los anuncios de la plataforma.